AI ciągle na rozdrożu

Tylko od nas ludzi zależy, jak wykorzystamy AI. Czy będzie służyć powszechnemu dobru, czy może obróci się przeciwko niemu?

Przed takim dylematem stanęła właśnie Unia Europejska, przyjmując pierwszą na świecie kompleksową regulację dotyczącą sztucznej inteligencji (AI Act). W czerwcu po ponad dwóch latach prac, konsultacji i negocjacji Parlament Europejski osiągnął kompromis, przyjmując rewolucyjne rozporządzenie.

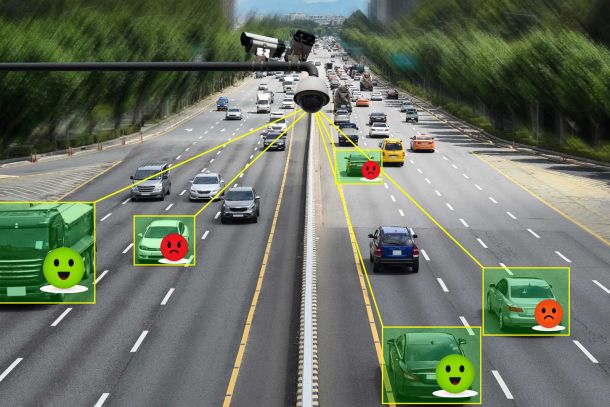

Kontrowersje pojawiły się na ostatniej prostej, kiedy to w sposób niesygnalizowany Europejska Partia Ludowa, mająca większość w PE, tuż przed ostatecznym głosowaniem wróciła do poprawek dopuszczających masową inwigilację z użyciem AI w interesie bezpieczeństwa publicznego. Ich autorzy uzasadniali, że są one konieczne, aby skutecznie prowadzić akcje antyterrorystyczne czy związane z poszukiwaniem zaginionych dzieci. W tym celu mógłby zostać użyty system rozpoznawania twarzy w czasie rzeczywistym, profilowania zachowań przestępczych, a nawet definiowania ludzkich emocji. Służby mogłyby w tym celu wykorzystać monitoring publiczny, prowadząc inwigilację na dużą skalę.

Takie rozwiązania od lat z powodzeniem funkcjonują w Chinach, wzmacniając komunistyczny reżim. A stworzony dzięki nowym technologiom system społecznych punktów dzielących obywateli na dobrych i złych zaczyna przerastać nawet orwellowską wizję kontroli społeczeństwa.

Jak na razie podejście ochrony praw obywatelskich zwyciężyło w Parlamencie Europejskim. Większością głosów odrzucono poprawki, wprowadzono też zakazy stosowanie inwigilacji z użyciem AI. Zaakceptowanych zostało za to wiele potrzebnych rozwiązań chroniących obywateli i ich prawa. Określone zostały zasady przejrzystego działania AI. Treści generowane przez sztuczną inteligencję będą musiały być wyraźnie oznaczone. Wdrożone zostaną też mechanizmy pozwalające na walkę z tzw. deep fake.

Ponadto operatorzy systemów będą musieli ujawniać streszczenia treści objętych prawami autorskimi, które zostały wykorzystane w aplikacjach używających AI. Od dawna zabiegały o to m.in. wyższe uczelnie, gdyż rewolucja związana z upowszechnieniem ChatGPT (który potrafił w szybkim czasie wygenerować dowolną pracę naukową) stała się zagrożeniem dla świata nauki. Również konsumenci będą musieli być informowani, czy biznes w handlu i usługach stosuje wobec nich techniki, np. marketingowe, oparte o sztuczną inteligencję, co ma ograniczyć możliwości manipulacji.

To jednak nie koniec batalii o AI, wkrótce rozporządzeniem ma zająć się Rada Europejska, czyli szefowie rządów wszystkich państw członkowskich. To od nich finalnie zależy, jaki kształt przyjmie ostatecznie rozporządzenie AI Act i jakie uprawnienia zyskają służby. Upór w tej sprawie jest bardzo duży. Gra idzie o to, czy państwa i rządy zyskają nowe narzędzia do walki z przestępczością, stwarzające jednocześnie ryzyko, ingerując w naszą prywatność i swobody obywatelskie. Wypada mieć nadzieję, że demokracje europejskie unikną tej pokusy, nie odchodząc od wartości, na jakich zbudowany został starty kontynent. Wolności obywatelskie i prawa człowieka są jednym z fundamentów.

Dyskusje prawne o stworzeniu specjalnych przepisów dla AI trwają na całym świecie. Przykład unijny pokazuje, przed jakimi dylematami i zagrożeniami stoją demokracje w związku z rewolucją technologiczną. Dobrze, aby zdefiniować sobie je na samym początku, ofiar będzie mniej, bo to od nas, ludzi, zależy, jak będzie służyć sztuczna inteligencja, działając dla naszego dobra i zgodnie z naszą etyką.

Przeczytaj też:

Oko Saurona jest w Chinach?

Czy Chat GPT może zastąpić dziennikarzy prasowych?

Komunistyczna sztuczna inteligencja

Sztuczna inteligencja, sztuczna odpowiedzialność?

Cyfrowa puszka Pandory

Kierowcy u Wielkiego Brata

Czy technologia zniszczy instytucję rodziny?

Praca chińskiego cenzora bywa fajna

W odporności na kłamstwo siła

Jak okiełznać sztuczną inteligencję

Redaktor naczelny: Paweł Łepkowski | Edytor: Marta Narocka-Harasz

Kontakt: Ten adres pocztowy jest chroniony przed spamowaniem. Aby go zobaczyć, konieczne jest włączenie w przeglądarce obsługi JavaScript.

Stale współpracują: Zofia Brzezińska, Robert Cheda, Jacek Cieślak, Zuzanna Dąbrowska, Gaja Hajdarowicz, Grzegorz Hajdarowicz, Mariusz Janik, Krzysztof Kowalski, Hubert Kozieł, Marek Kutarba, Jakub „Gessler” Nowak, Tomasz Nowak, Joanna Matusik, Justyna Olszewska, Marcin Piasecki, Paweł Rochowicz.